Installare Open Web UI

Dopo aver installato Ollama sul nostro PC possiamo migliorare l’interazione, se desideriamo avere un ambiente più user friendly, attivando una WEB UI ossia un’interfaccia web che ci consenta di interagire con i vari modelli similmente a come si fare per Chat GPT, Gemini sul web.

La soluzione più semplice e facile da installare è Open WEBUI.

Open WEBUI può essere installata utilizzando Docker, Kubernetes o Python.

Per non appesantire troppo il nostro PC optiamo per la versione con Python.

Se intendete avvalervi di modelli che manipolando immagini, audio o video è consigliato installare ffmpeg. In Debian si può usare il comando:

apt install ffmpeg

Installazione di Open Web UI con Python su Linux

curl -LsSf https://astral.sh/uv/install.sh | sh

Riavviamo la shell, oppure lanciamo il seguente comando:

source $HOME/.local/bin/envQuesta versione di Open WEBUI richiede l’uso di Python 3.11 per cui scarichiamola e lanciamola in questo modo:

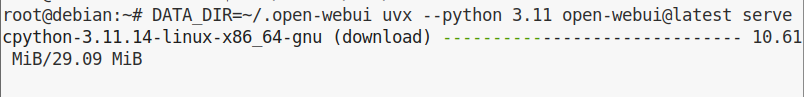

DATA_DIR=~/.open-webui uvx --python 3.11 open-webui@latest serve

In segutio sarà possibile aggiornare Open WEBUI con il seguente comando:

pip install -U open-webui

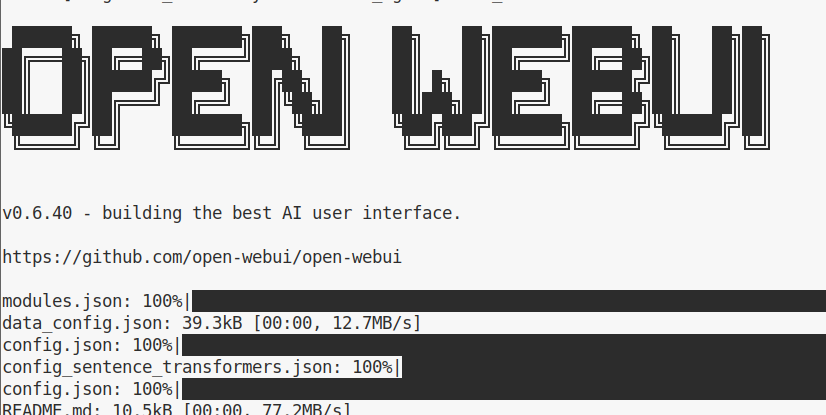

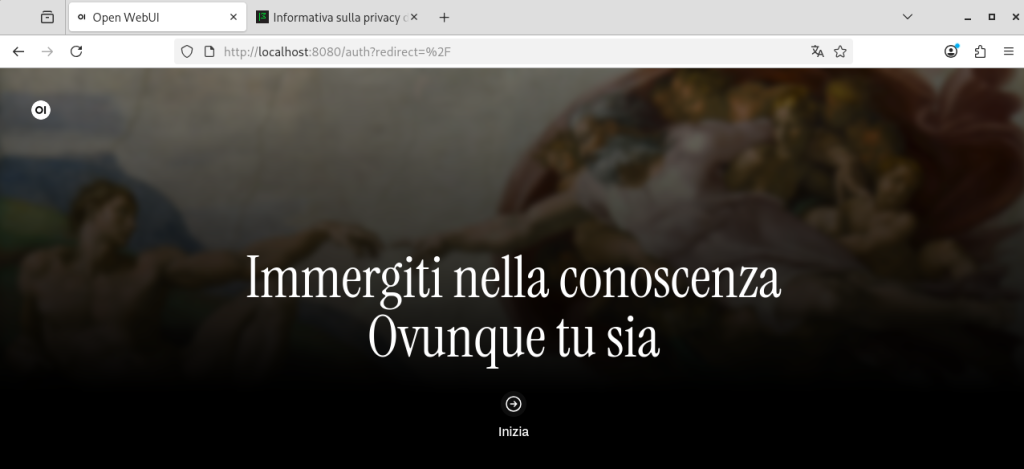

Dopo aver completato l’installazione e attivazione (automatica) della Open WEB UI apparirà questa schermata:

Per lanciare la Open WEBUI è sufficiente aprire il browser ed incollare questa URL:

Ed ecco la pagina che appare:

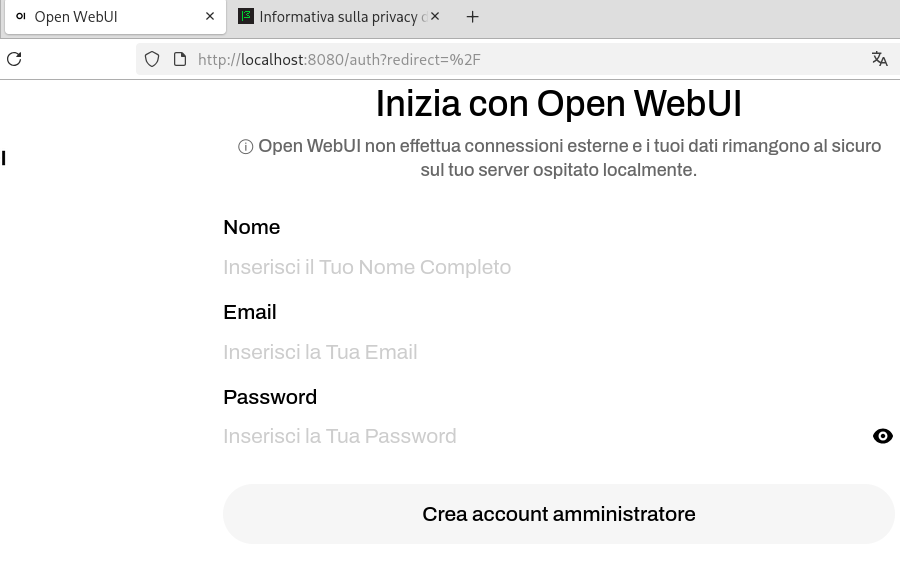

Cliccando su Inizia, verrà avviata la procedura guidata di configurazione.

E’ necessario creare un account per loggarsi al proprio server Open WEBUI.

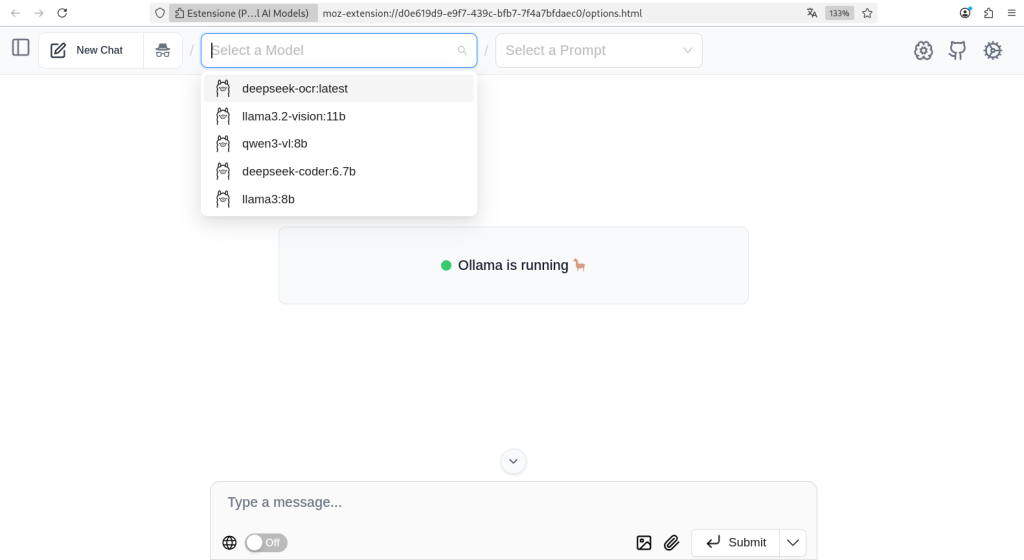

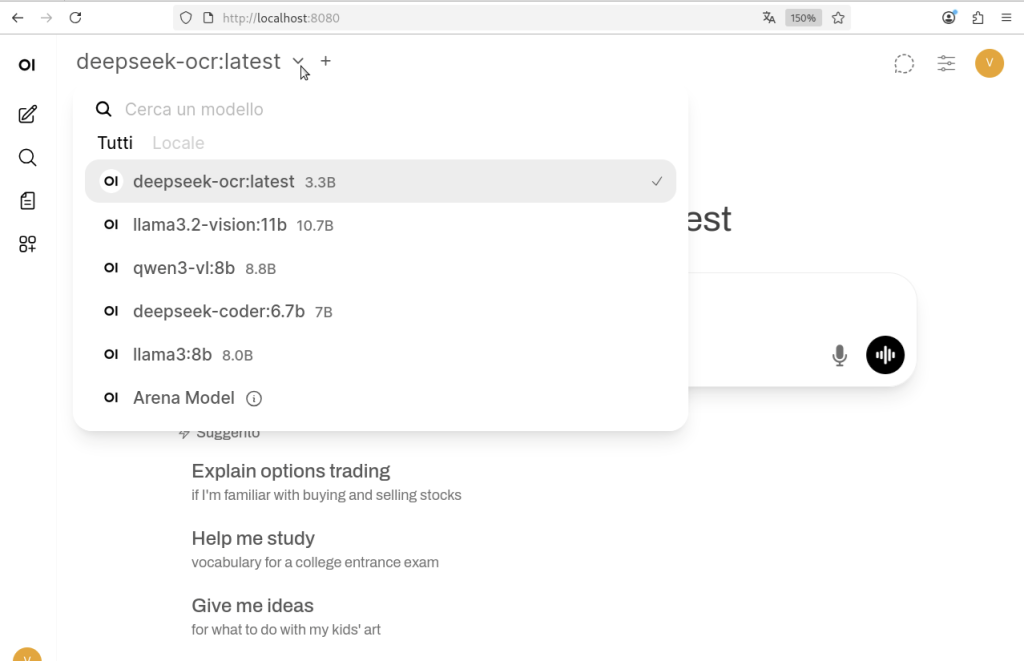

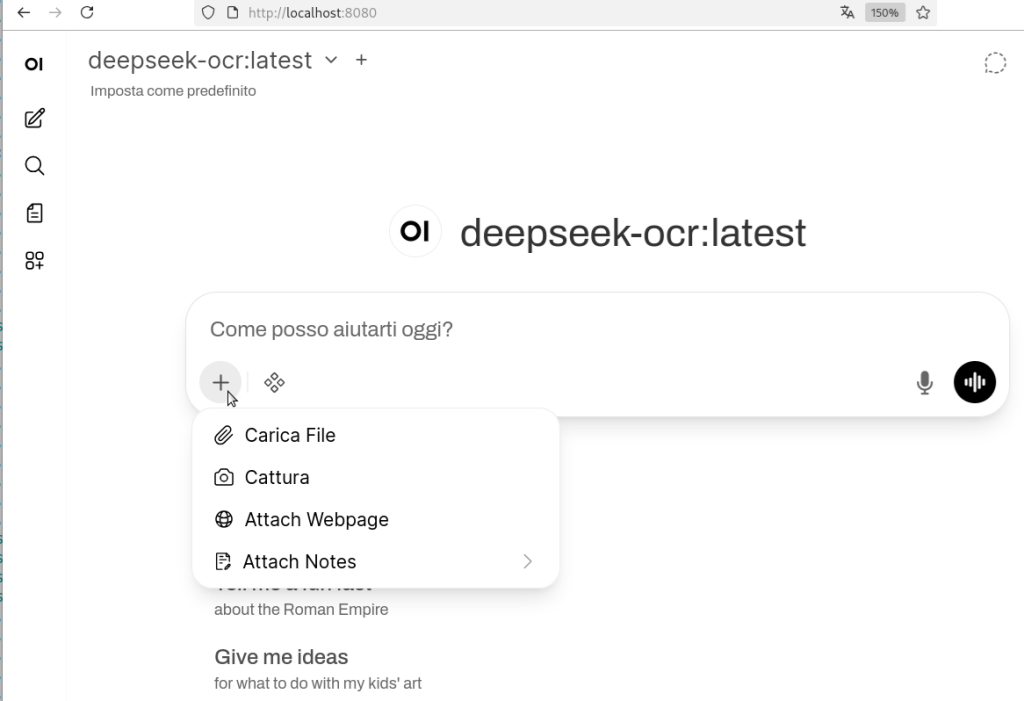

Dopo di che apparirà il familiare prompt per inviare le richieste al modelo di intelligenza artificiale. Possiamo anche selezionare un differente modello dal menù a tendina in alto a sinistra; questo se abbiamo attivato più di un modello su Ollama.

Per esempio, su questo PC è attivo il modello DeepSeek-OCR, questo consente di effettuare una conversione di immagini in testo, per cui è comodo aver un pulsante che consente di caricare l’immagine e chiedere al modello di effettuare il riconoscimento dei caratteri nell’immagine.

Page Assist

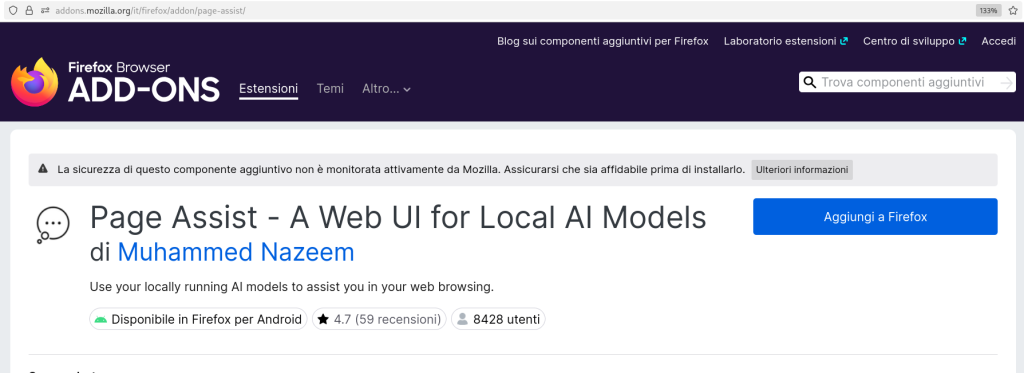

Se la velocità di risposta di Open WEB UI non vi soddisfa, ossia vi sembra eccessivamente lenta rispetto a quando lanciate una richiesta tramite Ollama, potete optare per usare un’estensione per il vostro web browser che si interfacci direttamente ad Ollama. L’estensione che suggerisco è Page Assist – A Web UI for Local AI Models per Firefox https://addons.mozilla.org/it/firefox/addon/page-assist/ oppure la stessa per Chrome https://chromewebstore.google.com/detail/jfgfiigpkhlkbnfnbobbkinehhfdhndo?utm_source=item-share-cb

Page Assist consente come Open WEB UI di selezionare un LLM: